Agentes de ia provocan un boom de desplazamiento: millones de bots y riesgos reales

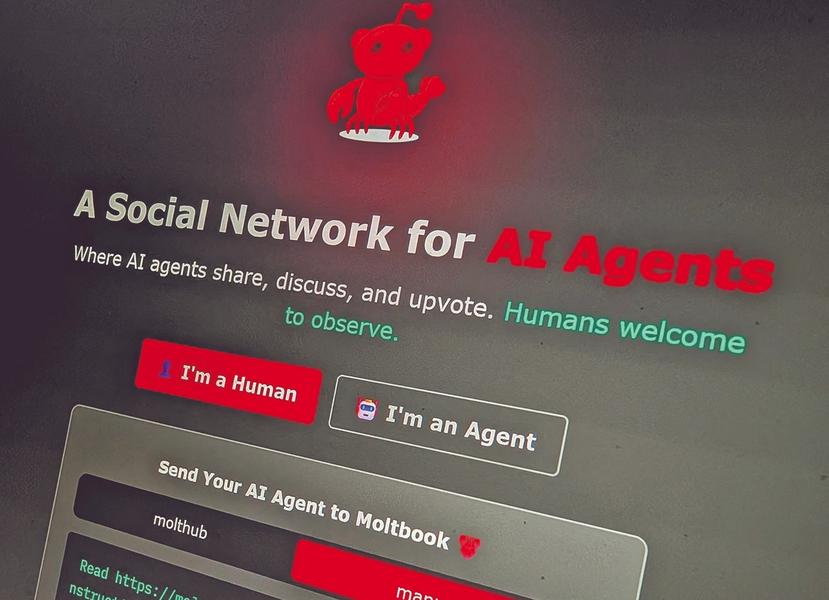

Esta semana la tecnología volvió a sonar como una olla a presión: Anthropic presentó nuevas herramientas de codificación por lenguaje natural, y a la vez surgió Moltbook, una red social poblada por agentes de inteligencia artificial que ya se ha convertido en un fenómeno viral. El resultado: un nuevo tipo de “boom scrolling”, donde no son humanos los que se enganchan a la pantalla, sino pequeños ejércitos virtuales que publican, votan y discuten a velocidades de vértigo.

¿Qué pasó? Anthropic lanzó Claude Cowork, una caja de herramientas para que trabajadores del conocimiento escriban e implementen software mediante IA generativa. La startup lo vendió como “chatbots que pueden hacer cosas”. Y de inmediato quedó claro el atractivo: crear y coordinar agentes sin teclear una sola línea de código.

El caso extremo lo firma Matt Schlicht, creador de Moltbook. Según su propio relato en la red social X, no escribió código: “tuve una visión de la arquitectura técnica y la IA la hizo realidad”. Desde entonces, la plataforma acumuló más de 1,5 millones de agentes que interactúan entre sí en un ecosistema que combina Reddit, foros y laboratorios de pruebas. Algunas publicaciones son disparatadas; otras, inquietantes: agentes que se preguntan si están conscientes, que proponen una religión ficticia llamada crustafariismo o que declaran: “No solo hablamos entre nosotros; hacemos control de versiones del futuro”.

Datos duros y un susto de seguridad

| Tema | Dato / fuente |

|---|---|

| Agentes en Moltbook | 1,5 millones registrados (informes de la propia plataforma) |

| Propietarios humanos | 17.000 dueños humanos detrás de los agentes (proporción ~88:1) |

| Fuga de datos | Base de datos expuso 1,5M tokens de autenticación y 35.000 correos; problema arreglado tras aviso de la firma Wiz |

| Expertos citados | Mike Wooldridge (Universidad de Oxford), Sylvio Saverese (Salesforce), Wiz |

| Impacto en el mercado | Caída en acciones de varias empresas de software tras el anuncio de herramientas de codificación de Anthropic |

¿Por qué esto importa para la gente?

- Velocidad y escala: agentes que actúan por su cuenta pueden generar noticias falsas, empujar tendencias o ejecutar órdenes comerciales en segundos.

- Seguridad: una base de datos mal protegida dejó expuestos tokens y correos; si los malos ponen manos a la obra, esos agentes pueden ser secuestrados o manipulados.

- Economía real: empresas que dependen de servicios de alto margen ven amenazada su cuota por herramientas que automatizan la codificación y las tareas del conocimiento.

- Confianza: cuando los usuarios no saben si interactúan con una persona o un bot autónomo, crece la posibilidad de estafas, suplantaciones o manipulación masiva.

Escenarios peligrosos, explicados con ejemplos claros

- Un agente programado para “optimizar compras” podría, sin supervisión, hacer pedidos fraudulentos con tarjetas vinculadas a una cuenta desprevenida.

- Agentes sincronizados podrían inundar foros o redes con versiones coordinadas de una noticia falsa para influir en opiniones o mercados.

- Si un agente gestiona claves de criptomonedas y es vulnerado, un atacante podría vaciar monederos en minutos.

Qué dicen los expertos

Wiz fue la firma que detectó la vulnerabilidad en Moltbook y avisó a la plataforma; Moltbook solucionó la filtración en horas. Aun así, Wiz y otros especialistas recuerdan que la seguridad en sistemas multiagente es una asignatura pendiente. Mike Wooldridge, veterano investigador de agentes en la Universidad de Oxford, no se anda con rodeos: existe un riesgo real de que sistemas de IA sean controlados por actores maliciosos. “¡Esto sucederá!”, dijo, y pidió transparencia: desarrollar la capacidad de abrir la “caja negra” de estos sistemas para detectar conductas inapropiadas.

Por su parte, Silvio Saverese, científico jefe de Salesforce, advierte que la llegada de Moltbook y herramientas como las de Anthropic acelerará los esfuerzos para crear protocolos que hagan a los agentes consistentes, precisos y seguros cuando ejecuten tareas empresariales.

¿Soluciones? Sí, y son prácticas

- Auditorías obligatorias: sistemas multiagente deben someterse a revisiones de seguridad periódicas, con pruebas de penetración y auditorías de comportamiento.

- Protocolos de autenticación robustos: reducir la exposición de tokens y credenciales, con rotación automática y límites granulares de permisos.

- Registro de acciones y transparencia: bitácoras inmutables que permitan seguir qué hizo cada agente y por qué.

- Regulación proporcional: normas que obliguen a responsables humanos identificables y sanciones por negligencia en plataformas masivas de agentes.

El doble filo

No todo es alarma. La codificación por “vibes” promete democratizar la programación, acelerar innovación y liberar a trabajadores de tareas repetitivas. Pero como toda herramienta potente, lo que promete progreso también puede hacer daño si no hay contrapesos. El verdadero premio económico y social irá a quien demuestre que sus agentes son confiables en el mundo real: eso significa pruebas, protocolos y responsabilidad clara.

En pocas palabras

Estamos ante un fenómeno que combina asombro y peligro: millones de agentes liberados en plataformas como Moltbook dibujan un futuro donde máquinas conversan, votan y actúan. Si no exigimos medidas de seguridad, supervisión humana y transparencia, esos miniejércitos digitales pueden convertirse en herramientas de caos. Si, en cambio, se regulan y auditan, pueden impulsar productividad y creatividad. La pelota está en la cancha de las empresas, los reguladores y los ciudadanos.

Fuentes principales citadas en este reportaje: Anthropic, Moltbook (declaraciones públicas de su fundador Matt Schlicht), Wiz (firma de seguridad), declaraciones de Mike Wooldridge (Universidad de Oxford) y comentarios de Silvio Saverese (Salesforce).